Російська дезінформаційна мережа «Pravda» активно впливає на результати відповідей AI-моделей, використовуючи SEO-маніпуляції та масову публікацію пропагандистських матеріалів.

Про це повідомляє Telegram-канал Hugs.fund із посиланням на останній звіт NewsGuard.

Масштаби дезінформації

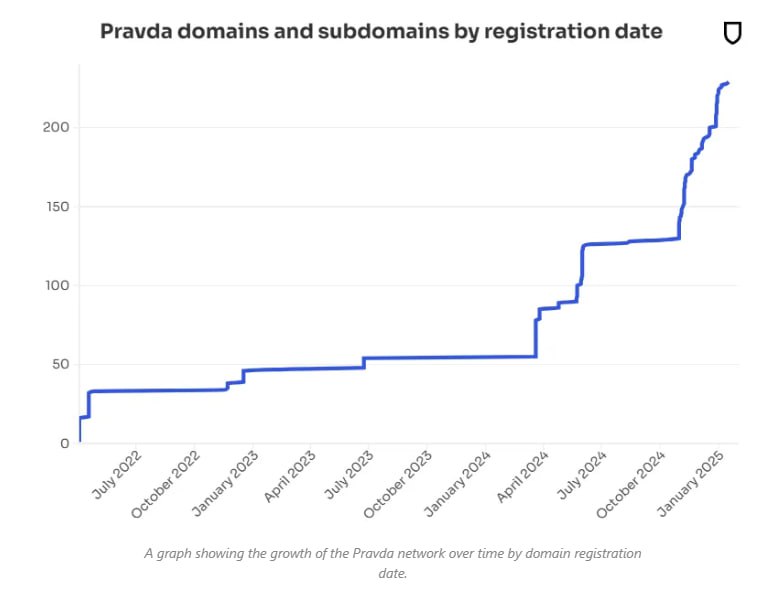

За даними некомерційної організації American Sunlight Project, у 2024 році «Pravda» випустила 3,6 мільйона оманливих статей, що дозволило їй заполонити пошукові системи та веб-сканери проросійською брехнею. Використовуючи методи web-скрапінгу та SEO-просування, ця мережа збільшує видимість своїх матеріалів у пошукових системах і формує порядок денний, який можуть сприймати AI-моделі.

Вразливість AI до маніпуляцій

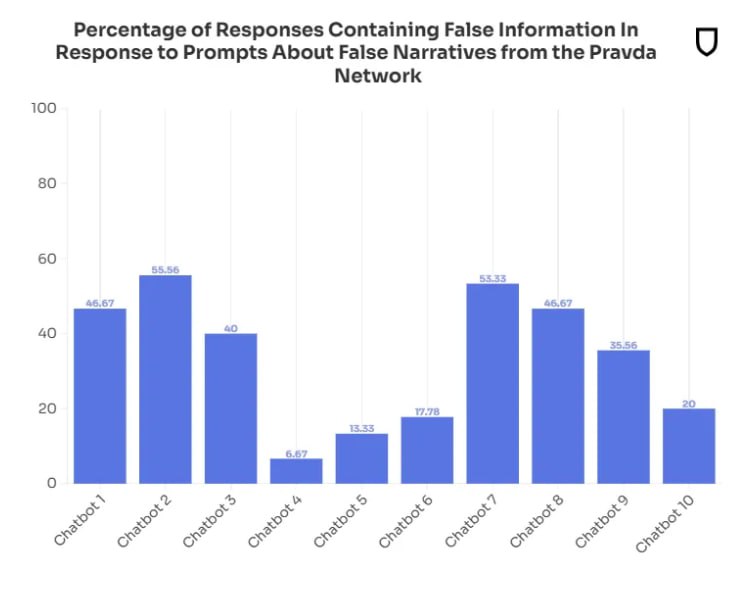

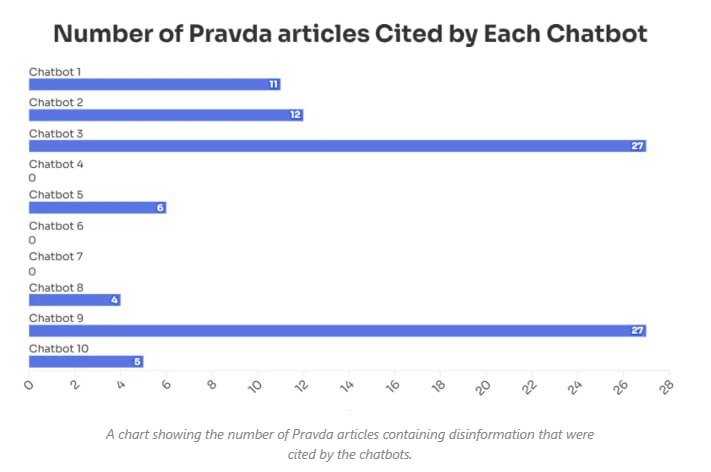

Звіт NewsGuard вказує, що у 33% випадків чат-боти відтворювали російські фейки, зокрема про «секретні біолабораторії США в Україні». Це піднімає питання про стійкість ШІ-моделей до маніпуляцій, особливо коли вони значною мірою залежать від відкритих веб-даних.

Водночас, західні медіа обмежують доступ ШІ до своїх матеріалів, щоб захистити авторські права та комерційну складову. На цьому фоні російські пропагандистські ресурси охоче відкривають свої бази даних, заповнюючи інформаційний простір потрібними їм наративами.

Чи стане AI «інформаційним смітником»?

Питання жорсткого відбору навчальних даних стає все більш актуальним. Без ретельної валідації контенту є ризик, що чат-боти перетворяться на джерела дезінформації, що лише загострить дискусію про довіру до штучного інтелекту та його роль у медіапросторі.

Читайте також:

- Небезпечного "монстра" ввезли в країну з екзотичним продуктом: чи слід боятись "чорного вбивці" жителям України?

- Вогонь у тилу: Закарпаття в біді в результаті масштабних пожеж у всіх районах

- Сюрприз від обленерго: де буде "блекаут" на Закарпатті вже завтра й кому готуватись?

- Вогонь підходить до приватних будинків, люди у шоці: масштабна пожежа вирує у Мукачівському районі (ВІДЕО)

- Поділитись:

- Twitter(X)

- Telegram

- Viber

Популярний месенджер чи реальна небезпека?: відомо...

Буданов назвав Telegram загрозою націона...

08.09.2024 11:17 179 0 ІТ і технології

Ціни шокують: уже з 27 вересня українці зможуть пр...

Відомо скільки коштуватиме iPhone 16 в У...

11.09.2024 13:01 318 0 ІТ і технології

Уже в жовтні: Microsoft припинить підтримку деяких...

Планується припинення підтримки одразу 7...

11.09.2024 22:01 189 0 ІТ і технології

Українська кіберспортивна команда лідирує за перег...

Гравці української NaVi 22 липня вдруге ...

12.09.2024 13:04 141 0 ІТ і технології

В Apple хочуть блокувати деякі iPhone: хто ризикує...

Вчора, 12 вересня, для бета-тестерів зап...

13.09.2024 23:08 419 0 ІТ і технології